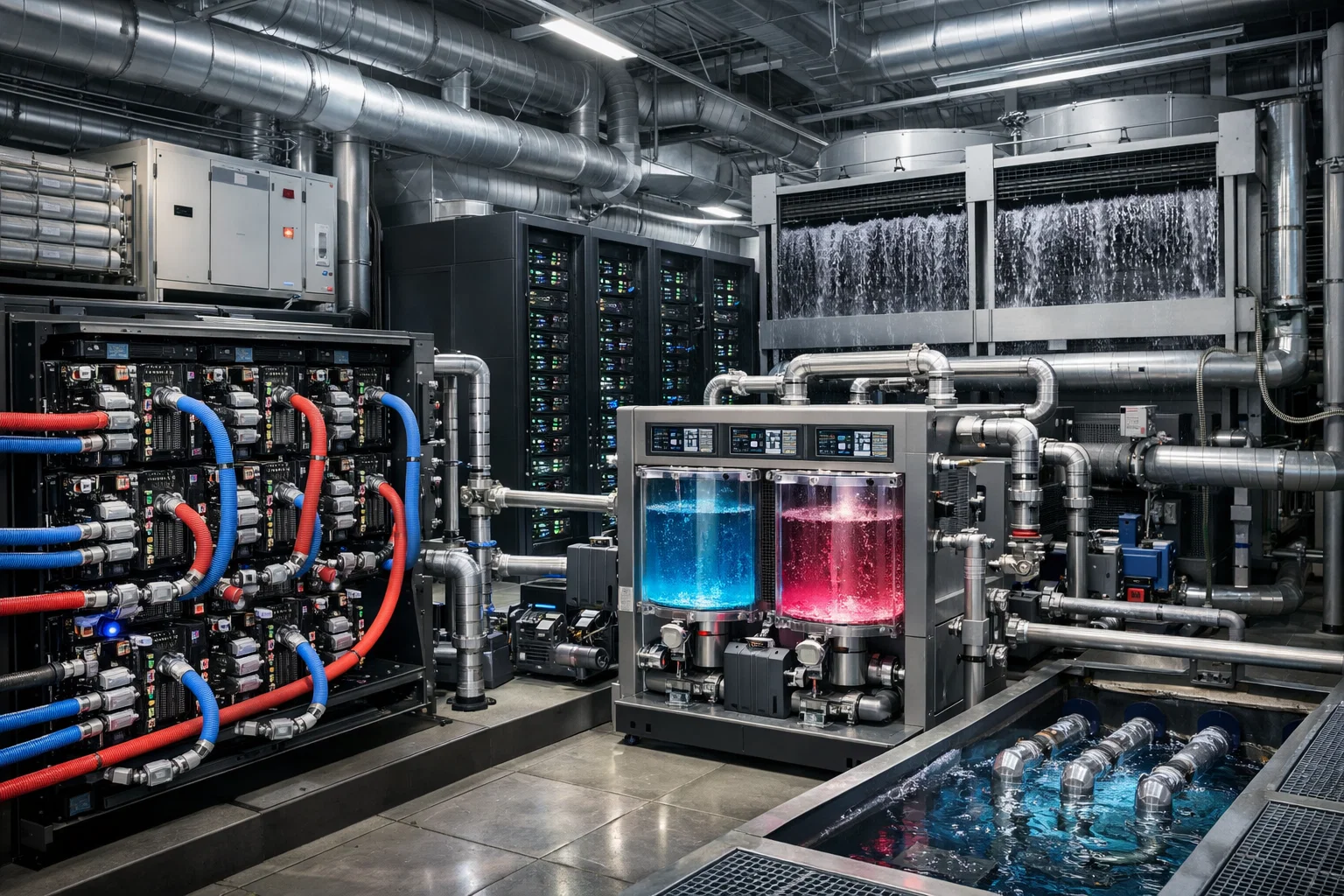

AI ЦОД изменили саму инженерную логику охлаждения дата-центров. Если классический серверный зал еще может долго работать на продвинутой воздушной схеме, то высокоплотные ИТ-нагрузки, характерные для современных GPU-кластеров, быстро подводят объект к границе, за которой обычный воздух перестает быть достаточным инструментом отвода тепла. Именно поэтому жидкостное охлаждение AI ЦОД перестало быть узкоспециализированной темой и стало одной из центральных задач для проектировщиков инженерной инфраструктуры. Вопрос уже не в том, можно ли использовать liquid cooling для дата-центра, а в том, на каком этапе оно становится действительно необходимым и как его правильно встроить в HVAC для AI инфраструктуры.

Главная причина этого сдвига проста: AI-нагрузка концентрирует большое количество тепла на ограниченной площади. Охлаждение GPU серверов требует не просто общей холодопроизводительности, а способности быстро и устойчиво снимать тепло с очень плотных вычислительных узлов. Воздушная система может справляться с этой задачей только до определенного уровня. Дальше ей приходится резко увеличивать объемы перемещаемого воздуха, усложнять аэродинамику, бороться с локальными перегревами и фактически работать на пределе своей практической эффективности. Именно в этот момент жидкостное охлаждение вычислительных кластеров перестает быть дополнительной опцией и становится логичным инженерным этапом развития AI ЦОД.

Почему AI ЦОД отличаются от обычных дата-центров

Главное отличие AI-площадок — в плотности и характере тепловой нагрузки. Классические дата-центры тоже выделяют много тепла, но AI ЦОД работают с куда более концентрированным тепловыделением внутри стойки и иногда даже внутри отдельных узлов. GPU-серверы, ускорители и связанные с ними вычислительные платформы создают такую нагрузку, при которой средний показатель по залу уже мало что объясняет. С инженерной точки зрения важна не только суммарная мощность объекта, но и то, насколько она сосредоточена локально.

Это означает, что HVAC для AI инфраструктуры должен решать сразу две задачи. Первая — поддерживать общую устойчивость климатической среды в машинном зале и во вспомогательных помещениях. Вторая — эффективно отводить тепло от наиболее плотных и нагруженных вычислительных зон. На определенном этапе эти задачи уже невозможно решать только воздухом с приемлемой сложностью и приемлемыми затратами.

Когда воздушная схема начинает терять эффективность

Воздушное охлаждение остается важной частью инженерной архитектуры дата-центра, но у него есть практические пределы. Чтобы отводить все больше тепла только воздухом, системе приходится увеличивать расход воздушных потоков, усложнять конфигурацию горячих и холодных коридоров, более жестко контролировать аэродинамику и исключать любые паразитные смешения потоков. На умеренной плотности это работает. Но при высокоплотных ИТ-нагрузках такая схема начинает становиться слишком чувствительной, энергоемкой и сложной в эксплуатации.

Особенно быстро ограничения воздушной схемы проявляются в нескольких случаях:

- когда GPU-стойки создают высокое тепловыделение на ограниченной площади;

- когда нагрузка продолжает расти поэтапно от очереди к очереди вычислительных узлов;

- когда объект требует стабильных уставок без резких колебаний в режиме 24/7;

- когда для удержания режима приходится чрезмерно увеличивать расход воздуха и усложнять зал.

В этот момент становится видно, что инженерная проблема уже заключается не в нехватке «еще одного кондиционера», а в самой физике воздушной схемы. И тогда жидкостное охлаждение AI ЦОД становится не вопросом моды, а вопросом инженерной необходимости.

Что дает жидкостное охлаждение для AI ЦОД

Основное преимущество liquid cooling для дата-центра состоит в том, что тепло снимается ближе к источнику его образования, а не только через общий объем воздуха в машинном зале. Это особенно важно для охлаждения GPU серверов, где локальная плотность тепловыделения может быть крайне высокой. Жидкий теплоноситель позволяет отводить тепло более адресно и предсказуемо, снижая нагрузку на воздушную часть системы.

С инженерной точки зрения это дает несколько ключевых эффектов:

- снижается зависимость от экстремально больших воздушных расходов;

- уменьшается риск локальных перегревов в наиболее плотных стойках;

- появляется возможность устойчиво работать с дальнейшим ростом мощности AI-кластеров;

- HVAC получает более сбалансированную роль в общей архитектуре объекта.

Именно поэтому жидкостное охлаждение вычислительных кластеров все чаще рассматривается как естественный этап развития инженерной схемы AI ЦОД, а не как экзотическое дополнение.

Когда liquid cooling становится действительно необходимым

Не каждый объект с AI-нагрузкой обязан начинать именно с жидкостной схемы. На ранних стадиях часть площадок может работать на усиленной воздушной архитектуре, особенно если плотность стоек еще умеренная, а развитие объекта идет поэтапно. Но необходимость liquid cooling становится заметной тогда, когда воздушная схема начинает требовать слишком сложной аэродинамики, слишком больших расходов воздуха и при этом все равно теряет устойчивость в горячих зонах.

Практически это можно понять по нескольким инженерным признакам:

- плотность стоек растет быстрее, чем воздушная схема успевает адаптироваться;

- локальные зоны перегрева начинают определять требования ко всему залу;

- рост вычислительных мощностей требует уже не усиления, а смены принципа теплоотвода;

- стоимость и сложность поддержания режима только воздухом становятся непропорционально высокими;

- объекту нужен запас по развитию AI-инфраструктуры, а воздушная схема такого запаса уже не дает.

Именно в этих условиях жидкостное охлаждение для AI ЦОД становится не экспериментом, а инженерно оправданным базовым направлением развития.

Как liquid cooling вписывается в HVAC-инфраструктуру

Очень важно понимать: жидкостное охлаждение не отменяет HVAC. Это одна из самых частых ошибок в обсуждении темы. Даже если значительная часть тепла отводится жидким контуром, объекту по-прежнему нужна полноценная HVAC-инфраструктура. Воздушная часть системы продолжает отвечать за климатическую среду машинного зала, за общую температуру помещения, за вспомогательные зоны, проходы, сервисные участки, операторские и за все то, что связано не только с вычислительным узлом, но и с самим зданием как инженерным объектом.

На практике HVAC для AI инфраструктуры при внедрении liquid cooling выполняет несколько функций:

- поддерживает общую воздушную среду в зале и соседних помещениях;

- снимает остаточную тепловую нагрузку, которая не уходит в жидкостный контур;

- обеспечивает эксплуатационный комфорт и устойчивость объекта;

- работает в связке с центральным холодоснабжением и автоматикой.

Это означает, что инженерные системы AI ЦОД должны проектироваться как совместная архитектура воздушной и жидкостной частей, а не как замена одной другой.

Что особенно важно при интеграции жидкостного охлаждения

Интеграция liquid cooling в инженерную систему требует более аккуратного проектного подхода, чем просто усиление воздушного охлаждения. Здесь необходимо заранее учитывать не только тепловую нагрузку, но и резервирование, мониторинг, сервисный доступ, контроль утечек, увязку с общей схемой холодоснабжения и перспективу дальнейшего наращивания мощности. Если жидкостный контур внедряется как отдельный фрагмент без пересмотра всей архитектуры, объект рискует получить новую сложность без полного инженерного эффекта.

Для правильной интеграции особенно важны:

- разделение ролей между жидкостной и воздушной частью системы;

- согласование жидкостного охлаждения с общей схемой холодоснабжения;

- резервирование и отказоустойчивость на уровне контуров и управления;

- детальный мониторинг критичных участков и тепловых режимов;

- подготовка системы к росту нагрузки, а не только к текущей конфигурации объекта.

Только такой подход позволяет сделать liquid cooling действительно рабочей частью инженерной инфраструктуры AI ЦОД.

Типовые ошибки при переходе к жидкостному охлаждению

На практике чаще всего встречаются следующие ошибки:

- попытка внедрить жидкостное охлаждение без пересмотра общей HVAC-архитектуры;

- непонимание того, какие функции сохраняются за воздушной системой;

- недооценка резервирования и сервисной логики;

- отсутствие сценария развития AI-нагрузки после внедрения liquid cooling;

- игнорирование мониторинга и контроля критичных тепловых зон;

- восприятие жидкостной схемы как локального технического дополнения, а не как части общей инженерной стратегии объекта.

Во всех этих случаях проблема одна: жидкостное охлаждение рассматривается отдельно от общей инженерной логики дата-центра, тогда как оно должно быть встроено в нее с самого начала.

Практический инженерный подход

Если объект ориентирован на AI-нагрузку или постепенно к ней движется, правильный подход состоит в том, чтобы заранее оценить пределы воздушной схемы и понять, на каком этапе жидкостное охлаждение станет рациональным. Для этого анализируют плотность стоек, тепловую карту оборудования, сценарий роста мощности, требования к стабильности режима и роль HVAC в общей архитектуре площадки. После этого уже определяется, какую часть нагрузки берет на себя жидкостный контур, а какую — воздушная инфраструктура.

Такой подход позволяет не просто внедрить liquid cooling, а сделать его логичным и устойчивым элементом инженерной системы AI ЦОД. Именно в этом случае жидкостное охлаждение работает не как реакция на проблему, а как заранее подготовленное решение для высокоплотной ИТ-нагрузки.

Вывод

Жидкостное охлаждение для AI ЦОД становится необходимым тогда, когда высокоплотные ИТ-нагрузки, GPU-серверы и вычислительные кластеры подводят воздушную схему к ее практическому пределу. Но liquid cooling не существует отдельно от HVAC: он должен вписываться в общую инженерную инфраструктуру дата-центра, где воздушная и жидкостная части работают совместно. Именно такой подход позволяет создать устойчивые инженерные системы AI ЦОД, способные поддерживать стабильный режим, развиваться вместе с ростом нагрузки и обеспечивать надежное охлаждение вычислительной инфраструктуры нового поколения.